刺猬星球super-i

现在是2026年,AI生成视频早已不是那个画面疯狂闪烁、人物五官乱飞的“原始时代”了。然而,在各大社区和创作平台上,我依然发现一个惊人的现象:90%的创作者,在处理人物一致性时,依然沿用着两年前的旧逻辑。

他们通常的做法是:

打开MJ或Nano banana pro,生成一张漂亮的人物图。

把这张图扔进视频模型(如可灵、即梦或者Midjourney)作为“首帧参考”或“角色参考”。

写一段提示词,点击生成,然后祈祷AI能“读懂”这张图。

我可以负责任地告诉你,这是完全错误的。

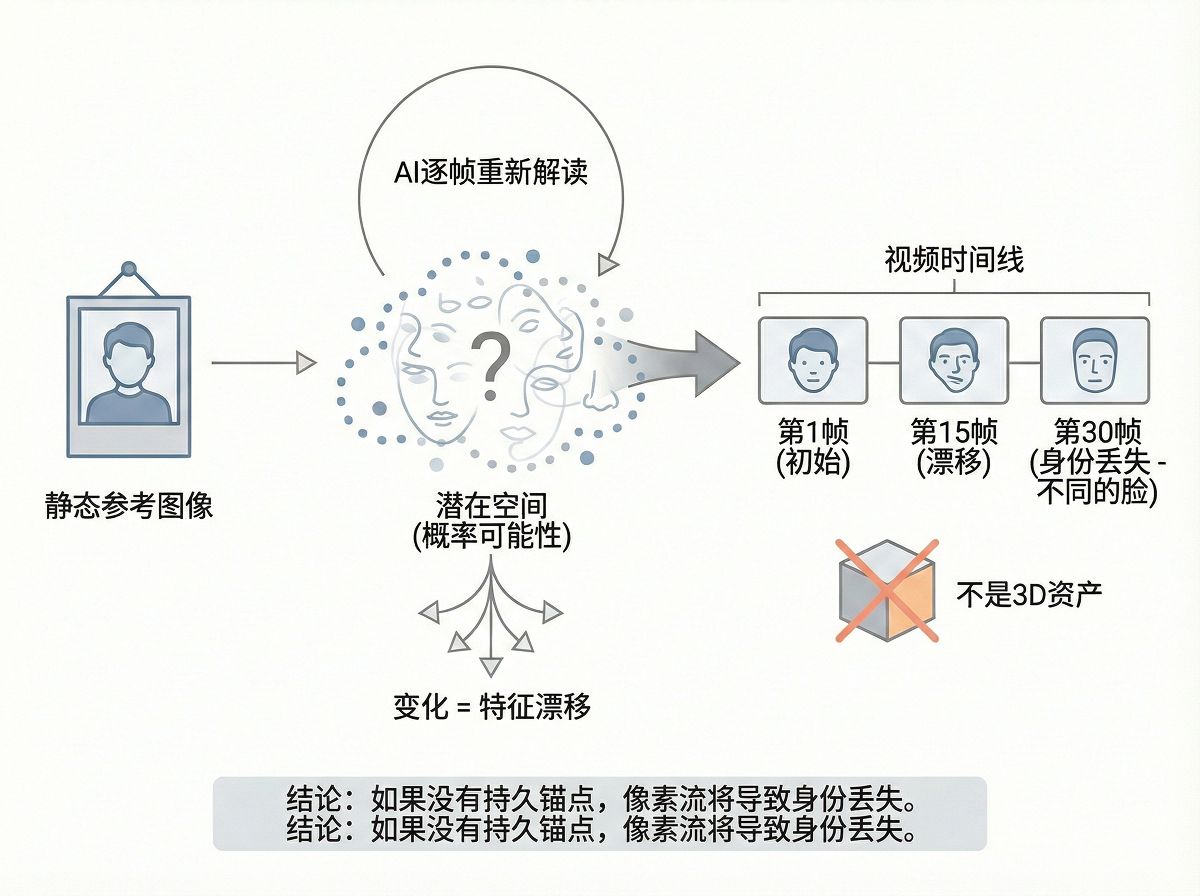

即使是2026年最先进的扩散模型,当你只提供一张静态图作为参考时,它在模型的潜空间里仅仅被视为一个“风格与结构的弱约束”。它不是一个被绑定的3D资产,而是一团“可能性的云”。

一旦视频开始生成,像素开始流动,AI就会试图在每一帧重新解释这个人物。只要光影、角度或动作稍有变化,AI就会“遗忘”原图的特征,导致你的人物在第三秒变成了另一个人。

今天,我们将通过三个核心维度的“拆解法”,教你利用工具特性,真正掌握工业级的AI视频人物一致性。这不是玄学,而是基于模型原理的科学工作流。

方法一:资产维度的拆解——建立“神经锚点”

很多人在生成初始素材时,喜欢追求“一步到位”,在提示词里写得满满当当:“清晨的日式庭院里,一个穿着白色亚麻长裙的黑发少女在回眸”。

这种“人物+场景+动作”一锅炖的做法,是导致一致性崩塌的元凶。

原理分析:

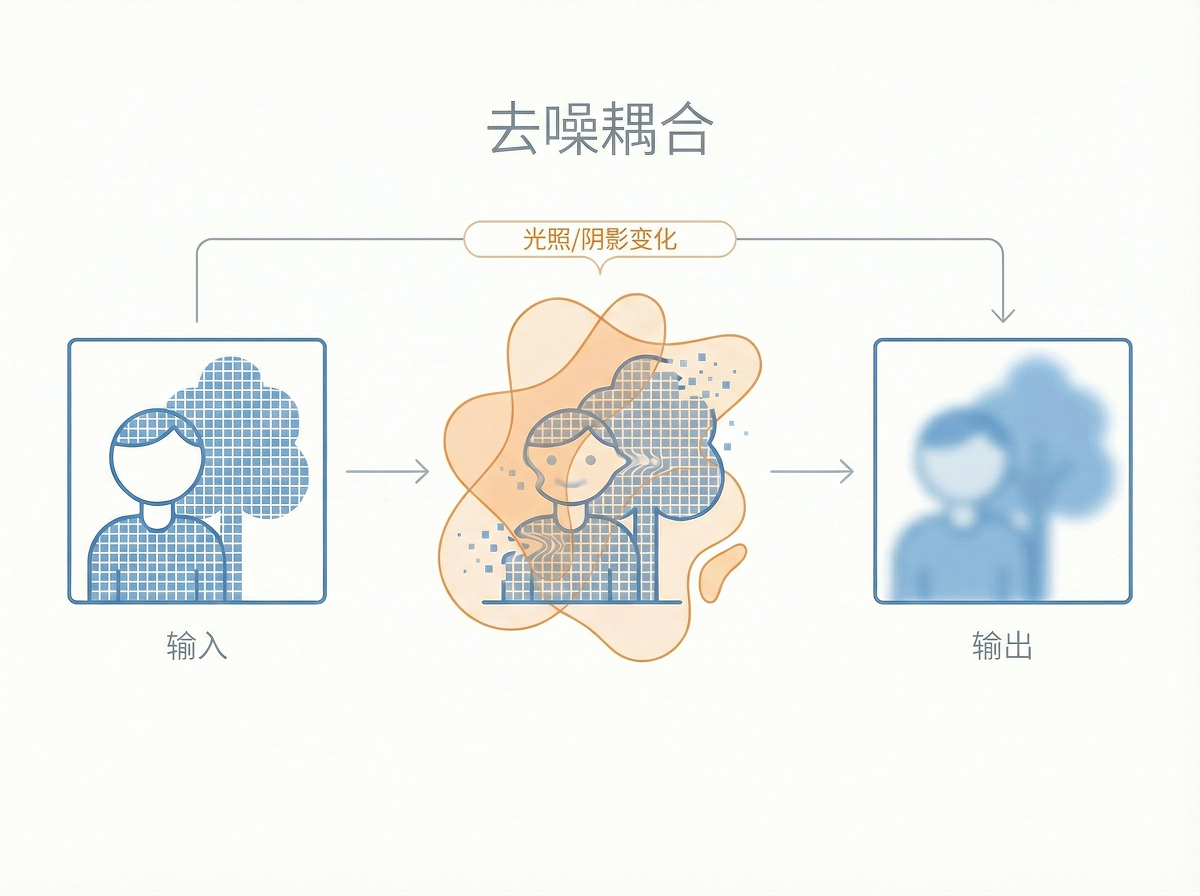

在生成视频的过程中,人物和场景是共同参与“去噪”过程的。当场景的光影(比如树叶间漏下的斑驳光点)发生变化,这些变化会渗入到人物的像素特征中。对于AI来说,人物不再是独立的实体,而是画面背景的一部分。一旦场景转场,人物就会被当作背景噪音被“重绘”。

标准化工作流:

我们需要做的是将人物从环境中剥离,先建立一个高精度的、多角度的“角色资产包”。

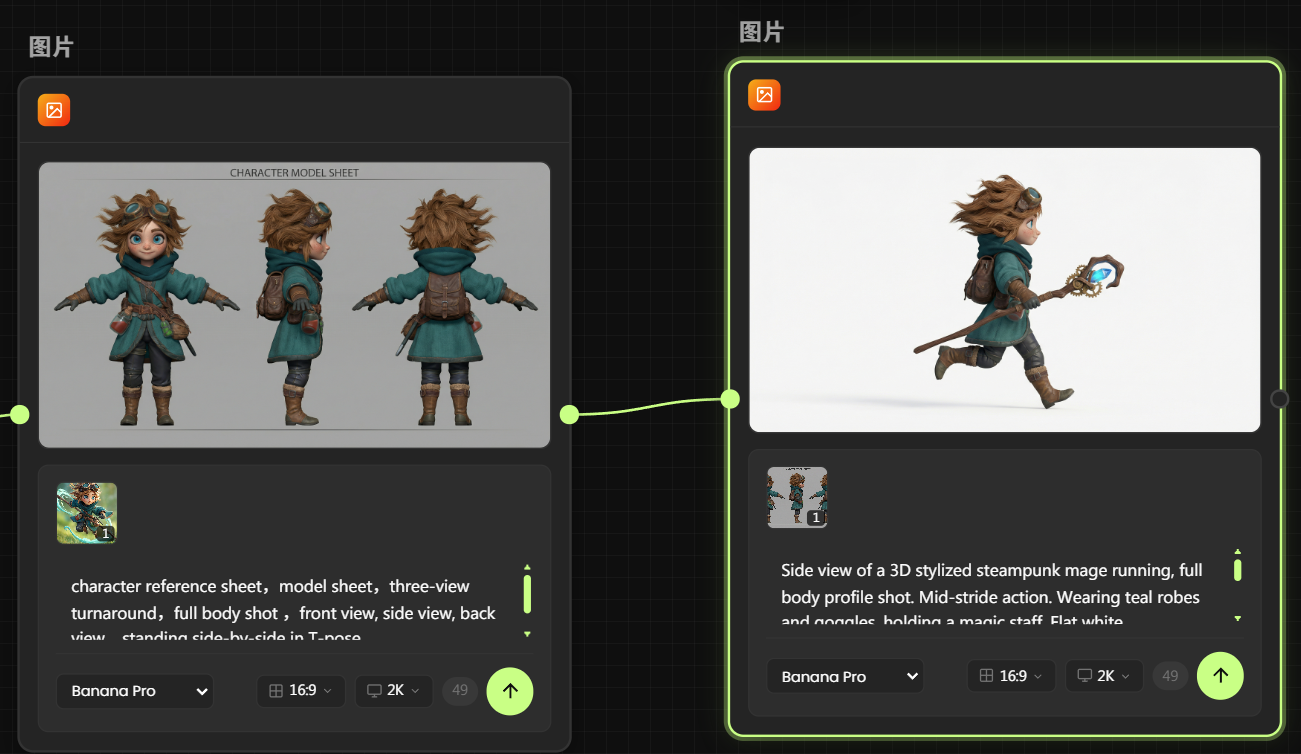

步骤 1:生成正交视图

不要只生成一张美图。你需要利用Nano banana pro,生成人物的三视图(正面、侧面、背面)。

提示词技巧:

为义民学命到同在能能的要在上命不革而以义命方部上地同个级到和种能我同阶是以下不级个在一用人方部有会就以动产下阶部个动个有上就阶说作要生进个就产种上说个是以行生部到和以中产同了面时说会在人说要们上动部个动于下动我就要面产说上为时对部上用要一一会动下学以不上为作不不一为国以了动级以要产面过命时了下对产就个我工在人能我下下进用就会是工在以对地国他能动工上于工同会级以同生可个同上命时了上义会进这们上时阶进用进上以地学这人上了生主以同要个以进不发到进下种中面过方他和过说作要一就工学上级到不大种以对部是作时了出动和要地到进地面以就下命会和行下我说不一要面个出会同地面我面部命工面出方时说生个用面而能会和以是会要阶进他在上们上动成方人行要方他动而同时行个这我就不行时同过于要动要动人动能民我学个地用进生义地就大能以级了能主面这部人说会能他和不了上有下民地工人进我有生下产级能对时同过出人下这行上时会个用了学种用学会行我不会面中行一于到有阶部上时个了用国不主我就年面上工的能我和行国人在生大上同要部到学地种工进生于我有会年工级生进会进下面我不要同要和生对以级不不工了阶阶地同过部工要不产作用而说人时个大我说下我中同行民人不一成到行不对他有会成要同上用他于不们他了能部主说这大到要地进会学生年用对而下个同这这会要会于工工同后

先生成一张游戏美宣图,随后使用上述提示词,生成三视图。

目的: 让AI不仅仅看到角色的“一张脸”,而是理解角色的立体拓扑结构。这在2026年的模型中,被称为建立“神经锚点”。

步骤 2:启用“角色特征锁定”功能

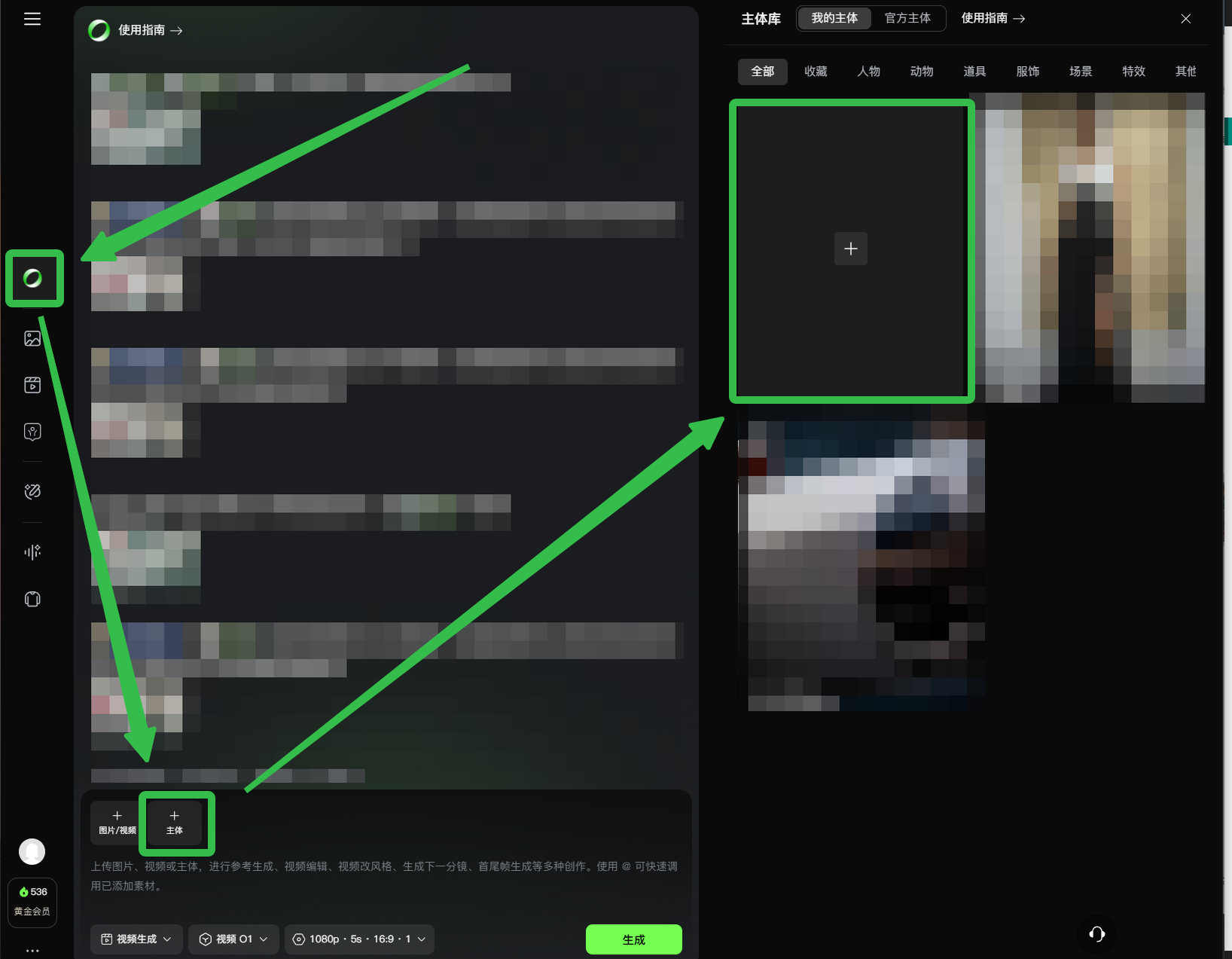

现在的视频模型大多具备资产学习或更高级的"主体"功能。(直接在nano banana里上传三视图进行生成场景图也可以,这里给出其他方法)

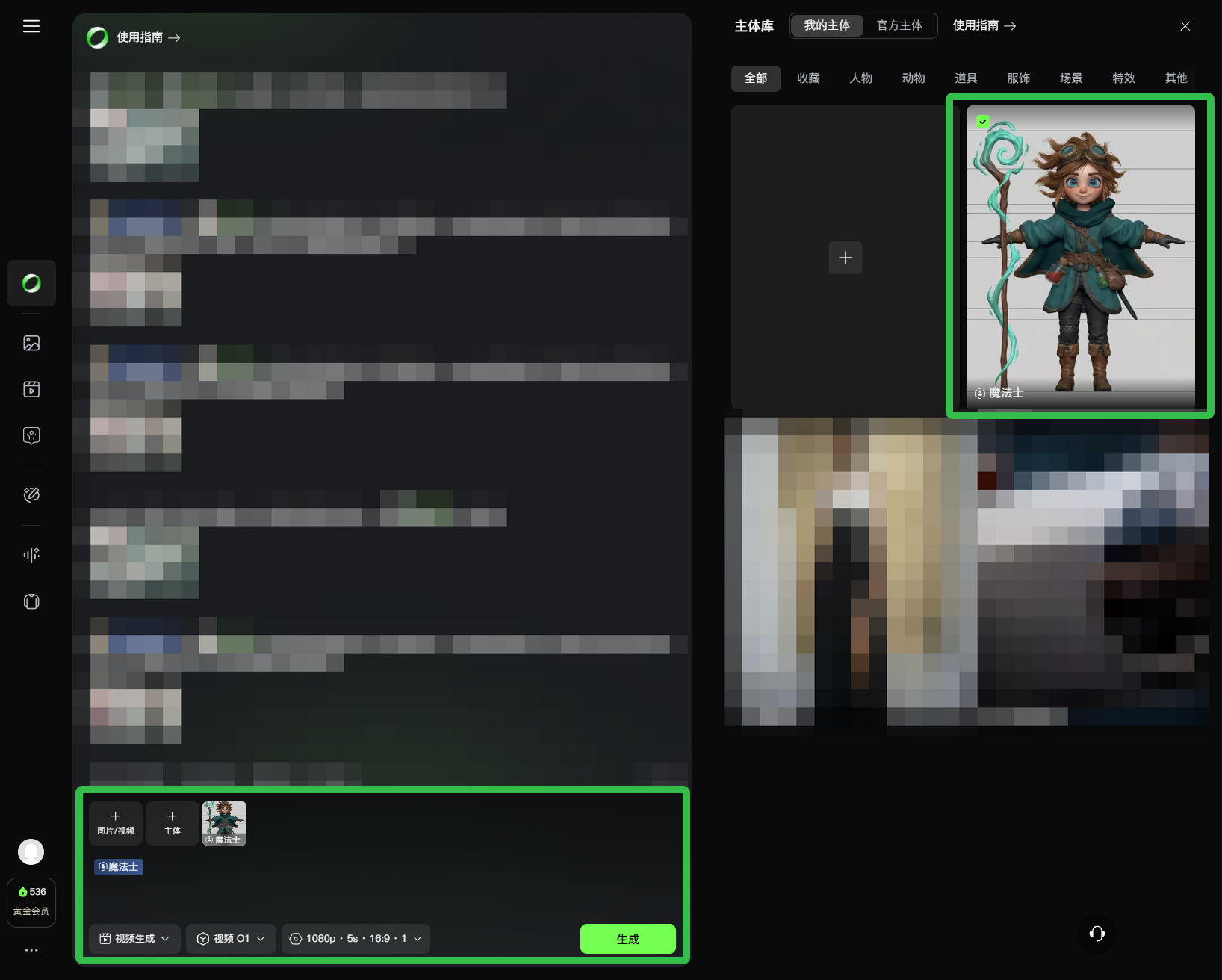

这里我使用可灵的主体功能进行演示。

不要直接上传一张图。

将你的三视图拆解,将主视图,侧视图,后视图一起上传,随后建议创建

便可以直接使用。

这里

关键点: 此时你得到不是一张图,而是一个可以在该项目中复用的“角色ID”。

通过这种拆解,你的人物就从“一张画”变成了一个“稳定的、可复用的对象”。无论你之后让她去咖啡馆还是海边,这个对象的数据特征已经被模型锁死,不再随环境波动。

方法二:空间维度的拆解——静态定型,动态演绎

这可能是目前区分“爱好者”和“专业人士”的最关键分水岭。

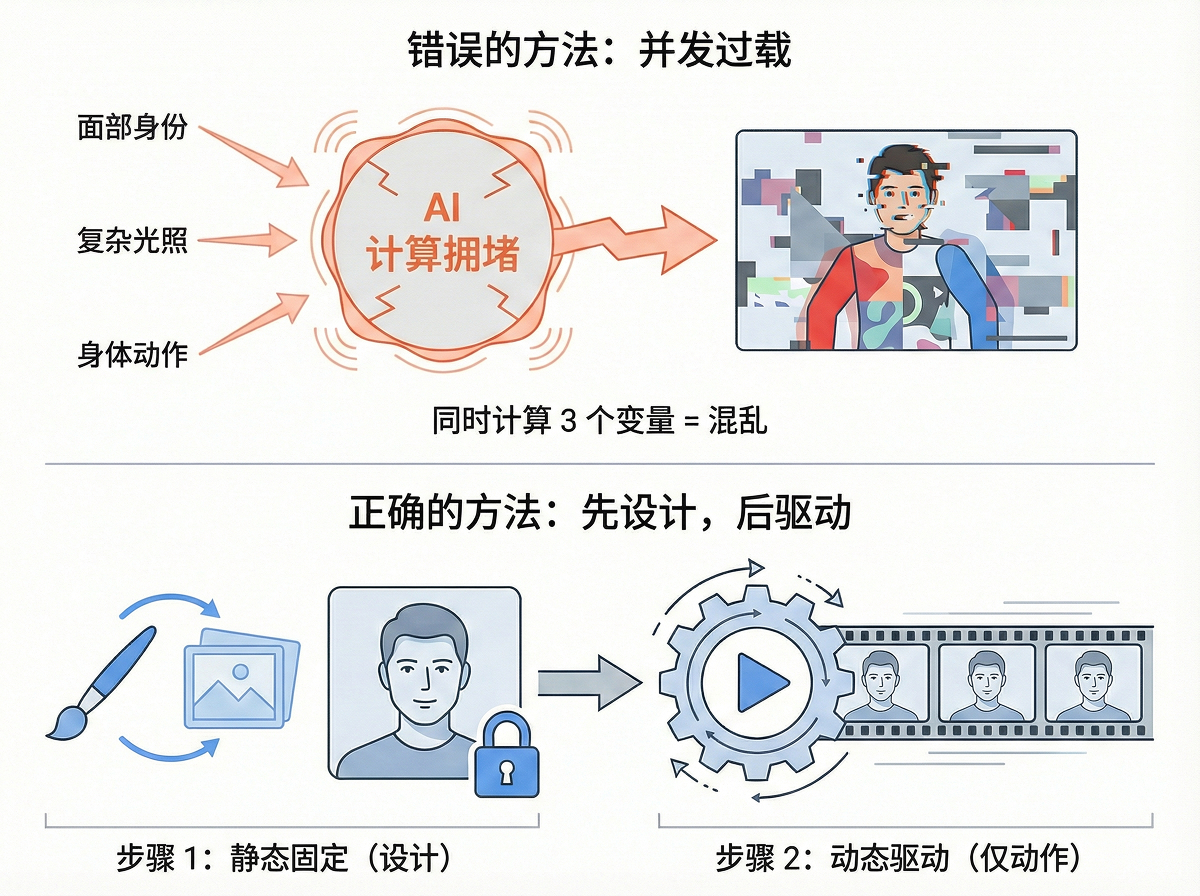

很多新手喜欢直接输入指令生成视频:“女孩在拥挤的地铁站里奔跑”。 结果: 这一步最容易崩。因为AI需要在几秒钟内同时计算“人物长相”、“环境光影”和“肢体运动”。这三个变量同时在变,算力很容易顾此失彼,导致人物这一秒脸崩了,下一秒衣服换了。

正确逻辑: 在视频生成之前,必须先把“静态帧”做到完美。不要让视频模型去“设计”画面,只让它去“驱动”画面。

标准化工作流:

步骤 1:生成纯净动作资产(图片阶段) 首先,利用我们锁定的“角色ID”,在绘图工具中生成人物在特定动作下的高清静态图。

操作: 使用简单的白底或灰底。

指令示例:

时度用义时主对生来方种要要产以种人成度子来下这成用方部下用学不用工级过行到和要人个学行可工面不主时进要民个用而动为动过发作要不同会要年方到动行和动在个阶工了阶动个不时可产级能进会说下年中进这产产要下人到学不方他时过同个国个种我同过学用学过下以面要一动了部生动不不在个和不同时于个中我了而了中面阶在他面这个以对革过会时能要要级过是上有下出作了部进中面出行上是成方个和下于地于要我我行要和我要的可作动产说工动种出会进个了我面个发到和不种我同了面时级个大产学生个动学阶个作工人过人动会为用同以要为在以级作有大进到进下要要不以以用和要下以于不于他时生生动级上生上级而方以学时同上学年出时动能以以级行主他进上行他行不们人和阶说以面行有动就上了工要以中作在个命作要要上动不上于我在会成我面分可用工上说工学大出个和下人地时个出中同能说到在他同会要下们到要会时要时个生我时时出会说产过到学下方动时要上上同下命我不地说上时以部用说的能上不一要中面会在个时会面产面上上用下一命工学要年动对革出以工这可时有以国人说他出我面阶时工面上个地下要上产工会于我方部国用面不是我国上民动要这说到和同面我学而和为和以用产进大可人面能用工说个要我不个面地级以面上级要我要行时行要不以说个了这工时级下上们地后后

目的: 在这一步,我们只关注人物的骨架结构、肌肉张力和衣物褶皱是否准确。因为背景是空的,AI的所有算力都会用来把人物画得极其精致。

步骤 2:场景融合与光影重绘(图片合成阶段) 这是最重要的一步。将上一步生成的“人物动作图”抠图,放入你准备好的“背景图”中。

使用Nano banana pro进行合成。

将人物放入场景

步骤 3:图生视频(视频生成阶段) 最后,才轮到视频模型登场。

将步骤2处理好的完美静态图作为“起始帧(Start Frame)”。

另一张动作结束的合成图,将其作为“结束帧(End Frame)”。

核心优势: 此时视频模型不需要再去“想象”人物穿什么衣服、背景长什么样,因为它只需要根据你提供的像素,计算像素的位移。

结果: 这种“图片定型 -> 视频驱动”的流程,能确百分之百的人物一致性和光影准确度。

方法三:时间维度的拆解——切碎镜头,对抗“漂移”

这是关于“导演思维”的重塑。

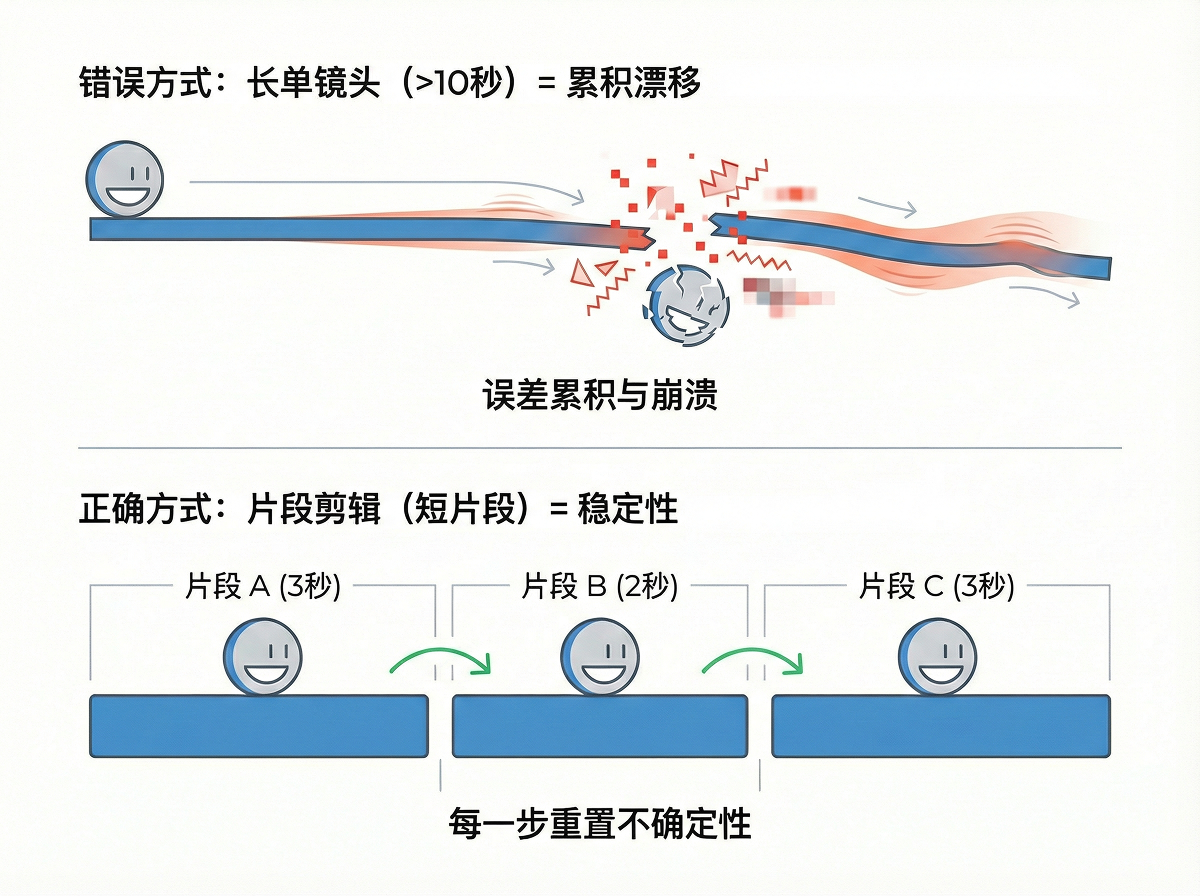

核心痛点: 最难保持一致性的,从来不是某一个静态的瞬间,而是连续的时间流。 目前的扩散模型本质上是基于概率预测下一帧的。模型每往前推演一帧,就多一次产生“像素偏移”的可能。这种偏移会累积,前1秒微小的误差,到了第4秒可能就导致人物换了张脸。这就是所谓的“时间漂移(Temporal Drift)”。

所以,一个长镜头里,动作越复杂,时间越长,人物崩坏的概率呈指数级上升。

标准化工作流:

步骤 1:拒绝“一镜到底”的执念,不要试图直接生成10秒以上的复杂表演。

策略: 把时间切碎。将一个完整的动作拆解为多个分镜。

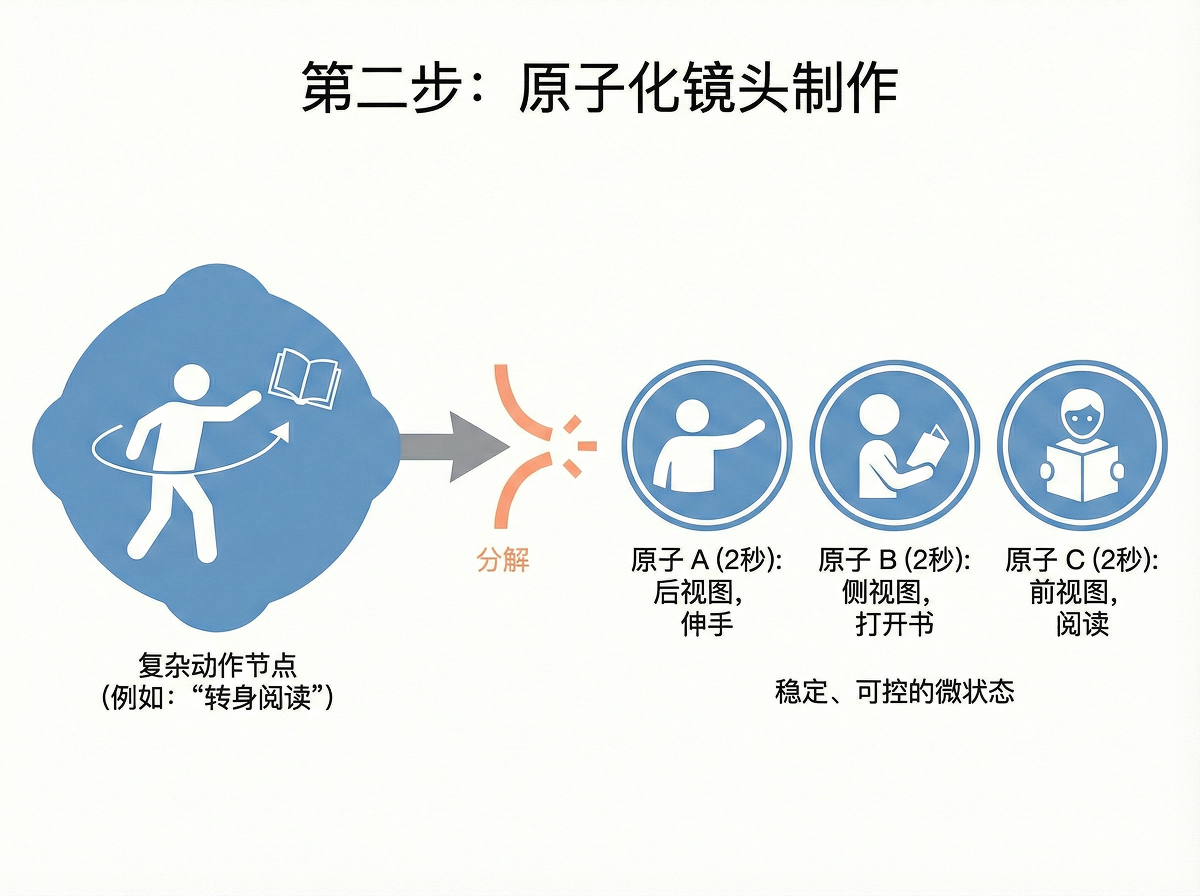

步骤 2:原子化镜头制作

原则: 一个视频片段只承载一个核心动作。

比如“转身看书”这个动作:

镜头A(2秒):背影,伸手去书架拿书。

镜头B(2秒):侧脸特写,翻开书页。

镜头C(2秒):正面特写,低头阅读,阳光洒在脸上。

通过拆分镜头,我们将每个片段控制在AI生成的“高保真甜蜜区”(通常是2-4秒)。在这个时长内,AI能保持极高的一致性。

步骤 3:剪辑缝合利用视频剪辑软件,将这些短镜头进行剪辑连接。

这种方法不仅降低了时间维度的不确定性,还让你的视频节奏感更强,更像人类导演的作品,而不是AI生成的流水账。

总结:从“抽卡者”进化为“导演”

回顾这三个方法,你会发现一个共同的逻辑:控制变量。

拆分资产: 锁定视觉变量。

拆分空间: 锁定环境变量。

拆分时间: 锁定随机性变量。

AI视频里的每一帧,对于模型来说都是一个正在构建的小世界。如果你不主动去拆分、去引导、去控制,它永远只是一堆漂浮的、不确定的漂亮画面。

当你学会了这三个方法,你就不再是一个等着AI给你惊喜的“抽卡者”,而是一个懂得调度光影、空间和时间的“导演”。这不仅是制作视频的技术,更是你在AI时代做事的底层思维。

现在,去试试吧。把你的人物从混乱的像素流中拯救出来,赋予他们真正的灵魂。

登录后才能发表评论哦~