超级个体

Super-i 每个人都可以成为超级个体

Midjourney 以往总能遇到一个问题:好不容易找到或是生成了一张风格绝美的图,想以此做个系列(比如同风格的角色三视图、场景分镜),结果新图要么线条变了味,要么色调跑偏,怎么调提示词都追不上第一张的感觉,这也是Midjourney之前一直被说“无法控制”的一大痛点。

但 v7 新出的 Sref(风格代码)功能,直接把这个问题解决了 —— 用一串数字代码,就能让所有生成图牢牢锁定同一种风格,不用再堆砌 “手绘质感 + 莫兰迪色调 + 粗线条” 这类废话描述。今天就用几组案例,带你吃透这个 “风格复制粘贴” 神器。

一、Sref 是什么?一句话说清核心用法

简单说,Sref 是 Midjourney 给每张图分配的 “风格身份证”。

当你生成一张满意的图时,它的详情页里会藏着一串类似“ --sref 2007748773 ”的代码,把这串代码粘到新的提示词末尾,新图就会自动继承原图的风格基因 —— 从线条粗细、色彩配比到笔触质感,都像同一个设计师画出来的。

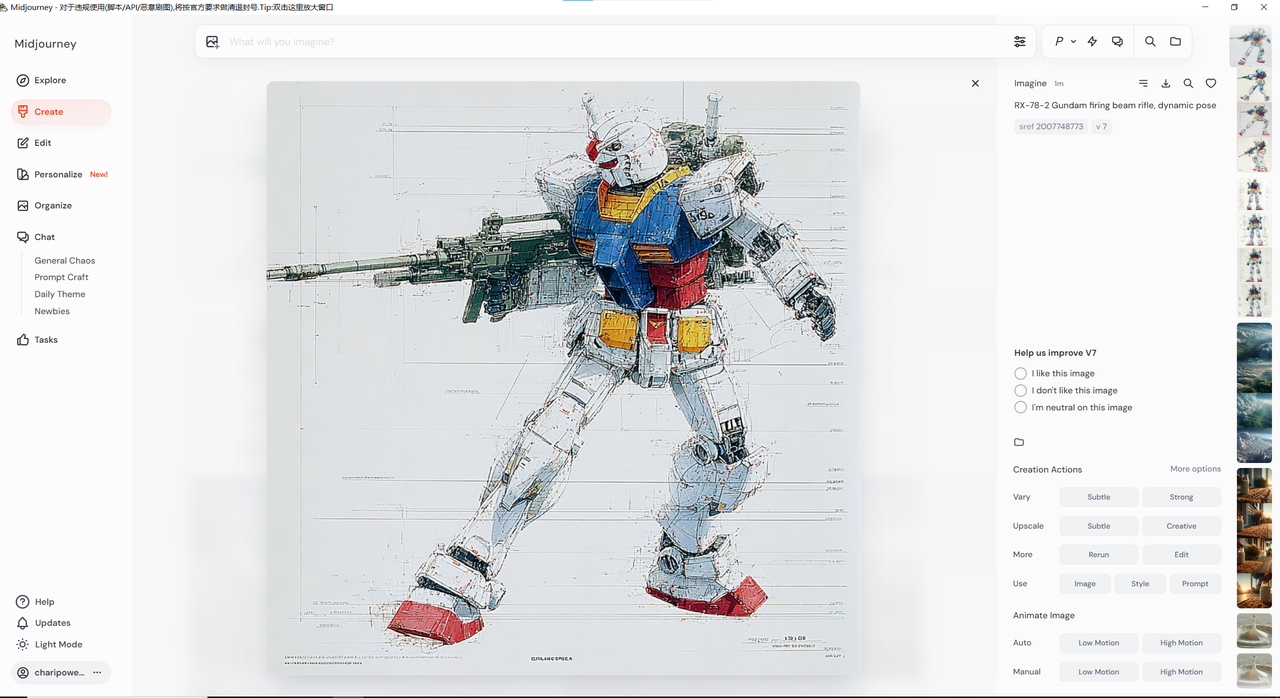

比如这个惊艳的 “线条艺术漫画” 风格高达:

RX-78-2 Gundam, line art comic style, engineering blueprint background, simple color blocks, --Sref 2007748773。

再做第二张 “高达射击姿态”,直接输入:

RX-78-2 Gundam firing beam rifle, dynamic pose --sref 2007748773

出来的图自动带着同款工程图纸背景、铅笔线条质感,甚至连色块的饱和度都和第一张分毫不差。

不用再纠结 “线条要多粗”“背景注释字体多大”,代码一粘,风格自动对齐。

二、 两组案例实测:Sref 怎么玩出花样?

案例 1:古风建筑系列 —— 从 “单体楼阁” 到 “全景城池”

基础图提示词:

Ancient Chinese pavilion, ink wash painting style, light gray background, scattered bamboo leaves, dry brush texture

生成后提取图片的代码 https://cdn.midjourney.com/9d058e4c-1938-4f80-b797-fa37fd56504f/0_1.png,这张图的水墨晕染感、笔触飞白都很有辨识度。

系列图 1:

Ancient city wall with watchtowers, morning mist --sref https://cdn.midjourney.com/9d058e4c-1938-4f80-b797-fa37fd56504f/0_1.png”

城墙的墨色浓淡和原楼阁一致,晨雾的晕染效果和背景竹叶的飞白笔触完全呼应,像出自同一卷画册。

系列图 2:

“Bridge over river in ancient town, sunset glow --sref https://cdn.midjourney.com/9d058e4c-1938-4f80-b797-fa37fd56504f/0_1.png”

案例 2:赛博朋克角色 —— 从 “主角” 到 “配角”

基础图提示词:

“Cyberpunk girl with neon hair, rain-soaked leather jacket, glitch effect on face, dark purple tone”

系列图 1:

“Cyberpunk boy with mechanical arm, standing in alley --sref https://cdn.midjourney.com/59698ed0-39ca-4344-9a8a-84088daf635b/0_2.png”

男孩的机械臂反光和女孩的皮衣反光强度一致,脸上的故障艺术效果(glitch)纹路和原图完全同风格,连背景里的霓虹灯晕都和原图的紫色调统一。

系列图 2:

Cyberpunk pet dog with metal collar, glowing eyes --sref https://cdn.midjourney.com/59698ed0-39ca-4344-9a8a-84088daf635b/0_2.png

三、用 Sref 的 3 个实用技巧

选对 “风格母本”:用来提取 Sref 的基础图,风格越独特越好(比如带明显笔触、特殊滤镜的图)。如果母本风格模糊(比如普通照片风),Sref 的作用会大打折扣。

微调强度看需求:在代码后加--sref_strength 0.8(默认 1.0),数值越低,新图保留自身元素的空间越大。比如想让角色换动作但风格不变,用 0.9;想让场景变但风格微调,用 0.7。

跨主题也能复用:比如用 “蒸汽波风格的猫” 的 Sref 代码,生成 “蒸汽波风格的汽车”,线条、色调、光影逻辑会完全继承,比重新写提示词高效 10 倍。

最后说句题外话:从 Sref 看产品思维

以前大家为了统一风格,得把 “线条粗细 5px、阴影透明度 30%” 这类细节塞进提示词,本质是 “用语言硬凑风格”。而 Sref 直接把风格变成 “可复用的代码”,相当于从 “每次做饭都要重新调配方” 变成 “直接用调好的酱料包”。

这种把用户 “反复试错的隐性需求” 变成 “一键调用的显性功能” 的思路,其实比功能本身更值得琢磨 —— 真正的好用,不是让用户更会用工具,而是让工具更懂用户 “懒得说出口” 的麻烦。下次再碰到 “操作太繁琐” 的问题,或许可以想想:能不能像 Sref 一样,给个 “一劳永逸” 的解法?